در مقاله اخیر “حقایق سریع” منتشر شده در مجله BMJ، محققان در مورد پیشرفتهای اخیر در هوش مصنوعی مولد (AI)، اهمیت فناوری در جهان امروز، و خطرات بالقوهای که باید قبل از تبدیل شدن مدلهای زبانی بزرگ (LLM) مانند ChatGPT به منابع قابل اعتماد اطلاعات واقعی مورد توجه قرار گیرند، بحث میکنند. آنها را باور کنید

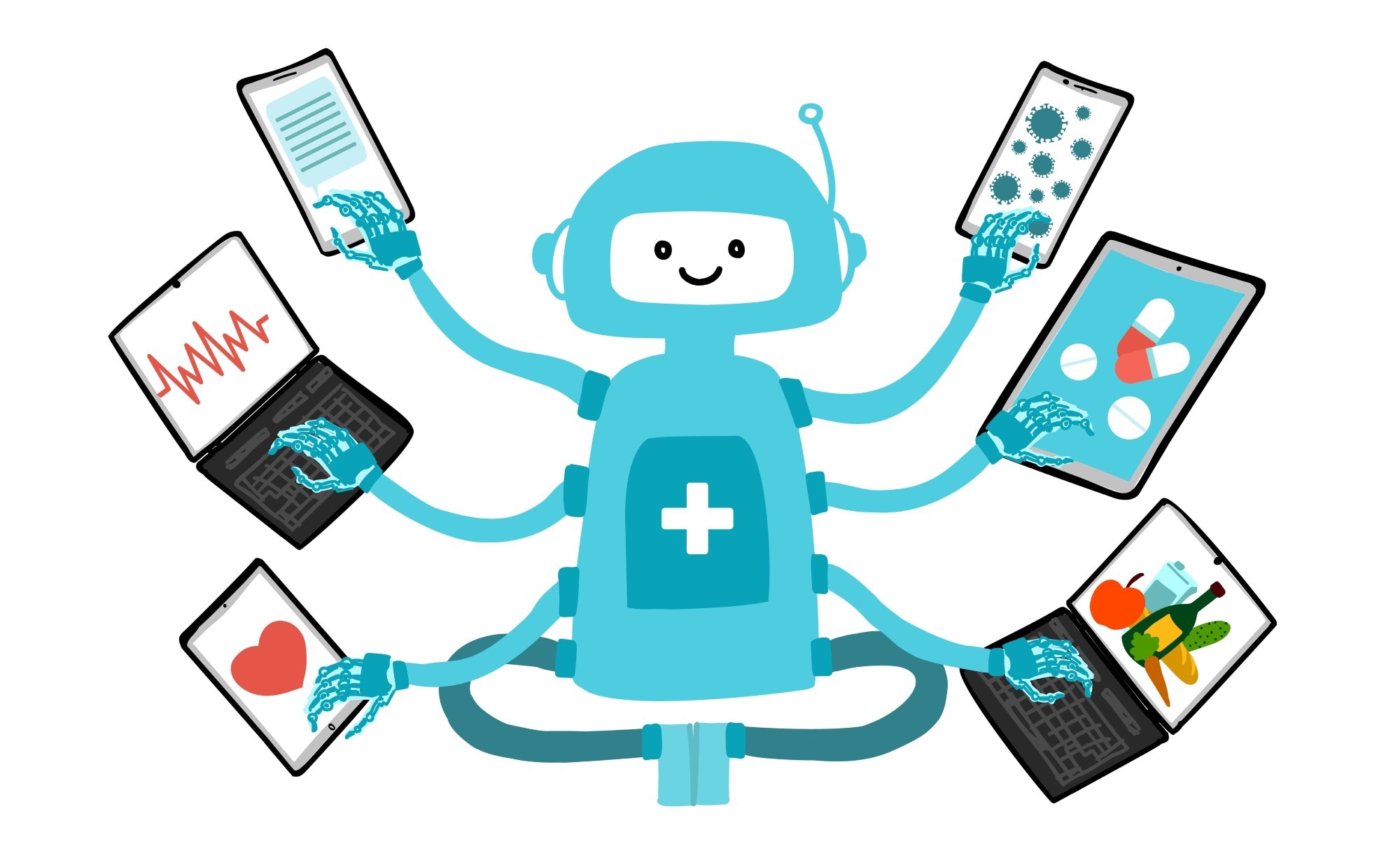

حقایق سریع BMJ: کیفیت و ایمنی اطلاعات سلامت تولید شده توسط هوش مصنوعی. اعتبار تصویر: Le Panda / Shutterstock

حقایق سریع BMJ: کیفیت و ایمنی اطلاعات سلامت تولید شده توسط هوش مصنوعی. اعتبار تصویر: Le Panda / Shutterstock

هوش مصنوعی مولد چیست؟

«هوش مصنوعی مولد (AI)» زیرمجموعهای از مدلهای هوش مصنوعی است که محتوای وابسته به زمینه (متن، تصاویر، صدا و ویدیو) ایجاد میکند و اساس مدلهای زبان طبیعی را تشکیل میدهد که دستیاران هوش مصنوعی (دستیار گوگل، آمازون الکسا و… Siri) و برنامه های بهره وری از جمله ChatGPT و Grammarly AI. این فناوری یکی از سریعترین بخشهای در حال رشد در محاسبات دیجیتال را نشان میدهد و پتانسیل پیشرفت قابل توجهی در جنبههای مختلف جامعه، از جمله مراقبتهای بهداشتی و تحقیقات پزشکی را دارد.

متأسفانه، پیشرفتها در هوش مصنوعی مولد، بهویژه مدلهای زبان بزرگ (LLM) مانند ChatGPT، به مراتب از بررسیهای اخلاقی و ایمنی پیشی گرفته است و احتمال عواقب شدید، تصادفی و عمدی (مخفف) را ایجاد میکند. تحقیقات تخمین میزند که بیش از ۷۰ درصد مردم از اینترنت بهعنوان منبع اصلی اطلاعات بهداشتی و پزشکی خود استفاده میکنند و افراد بیشتری هر روز با پرسشهای خود از LLMهایی مانند Gemini، ChatGPT و Copilot استفاده میکنند. مقاله حاضر بر سه جنبه آسیبپذیر هوش مصنوعی، یعنی خطاهای هوش مصنوعی، اطلاعات نادرست بهداشتی و نگرانیهای مربوط به حریم خصوصی تمرکز دارد. تلاشهای رشتههای جدید، از جمله ایمنی هوش مصنوعی و هوش مصنوعی اخلاقی، در رسیدگی به این آسیبپذیریها را برجسته میکند.

خطاهای هوش مصنوعی

خطاها در پردازش داده ها یک چالش رایج در تمام فناوری های هوش مصنوعی است. همانطور که مجموعه دادههای ورودی گستردهتر میشوند و خروجیهای مدل (متن، صدا، تصاویر یا ویدیو) پیچیدهتر میشوند، شناسایی اطلاعات اشتباه یا گمراهکننده به طور فزایندهای چالشبرانگیزتر میشود.

“پدیده “توهم AI” با استفاده گسترده از چت ربات های هوش مصنوعی (به عنوان مثال، ChatGPT) که توسط LLM ها ارائه می شود، برجسته شده است. در زمینه اطلاعات سلامت، توهمات هوش مصنوعی به ویژه نگران کننده است زیرا افراد ممکن است اطلاعات بهداشتی نادرست یا گمراه کننده ای را از LLM ها دریافت کنند. به عنوان واقعیت ارائه می شود.»

برای اعضای غیردولتی جامعه که قادر به تشخیص اطلاعات واقعی و نادرست نیستند، این اشتباهات می توانند بسیار سریع و پرهزینه شوند، به ویژه در موارد اطلاعات پزشکی اشتباه. با توجه به تحقیقات فزاینده ای که با استفاده از LLM و هوش مصنوعی مولد برای تجزیه و تحلیل داده ها انجام می شود، حتی متخصصان پزشکی آموزش دیده نیز ممکن است از این خطاها رنج ببرند.

خوشبختانه، استراتژیهای فنآوری متعددی با هدف کاهش خطاهای هوش مصنوعی در حال حاضر در حال توسعه هستند که امیدوارکنندهترین آنها شامل توسعه مدلهای هوش مصنوعی مولد است که خود را بر اساس اطلاعات به دست آمده از منابع معتبر و معتبر “پایه” میدهند. روش دیگر گنجاندن «عدم قطعیت» در نتیجه مدل هوش مصنوعی – هنگام ارائه یک خروجی است. این مدل همچنین درجه اطمینان خود را در مورد اعتبار اطلاعات ارائه شده ارائه می دهد، بنابراین به کاربر اجازه می دهد تا در موارد عدم قطعیت بالا به مخازن اطلاعات معتبر مراجعه کند. برخی از مدلهای هوش مصنوعی مولد از قبل نقلقولها را به عنوان بخشی از نتایج خود گنجاندهاند، در نتیجه کاربر را تشویق میکنند تا قبل از پذیرش خروجی مدل بهعنوان ارزش اسمی، خود را بیشتر آموزش دهند.

اطلاعات غلط بهداشتی

اطلاعات نادرست از توهمات هوش مصنوعی متمایز است زیرا دومی تصادفی و سهوی است، در حالی که اولی عمدی و بدخواهانه است. در حالی که روش اطلاعرسانی نادرست به قدمت خود جامعه بشری است، هوش مصنوعی مولد یک پلتفرم بیسابقه برای تولید «اطلاعات نادرست متنوع، با کیفیت بالا و هدفمند در مقیاس» است که تقریباً هیچ هزینه مالی برای بازیگر مخرب ندارد.

“یک گزینه برای جلوگیری از اطلاعات نادرست بهداشتی تولید شده توسط هوش مصنوعی شامل تنظیم دقیق مدلها برای همسویی با ارزشها و ترجیحات انسانی، از جمله جلوگیری از ایجاد پاسخهای مضر یا نادرست شناخته شده است. یک جایگزین، ساخت یک مدل تخصصی (جدا از مدل هوش مصنوعی مولد) است. برای شناسایی درخواست ها و پاسخ های نامناسب یا مضر.”

در حالی که هر دو تکنیک فوق در جنگ علیه اطلاعات نادرست قابل اجرا هستند، آزمایشی و مدلدار هستند. برای جلوگیری از رسیدن داده های نادرست حتی به مدل برای پردازش، ابتکاراتی مانند واترمارک دیجیتال که برای اعتبارسنجی داده های دقیق و نمایش محتوای تولید شده توسط هوش مصنوعی طراحی شده است، در حال حاضر در حال انجام است. به همان اندازه مهم، ایجاد آژانسهای هوش مصنوعی قبل از اینکه بتوان بدون چون و چرا به عنوان یک سیستم تحویل اطلاعات قوی اعتماد کرد، لازم است.

حریم خصوصی و تعصب

دادههای مورد استفاده برای آموزش مدلهای هوش مصنوعی مولد، بهویژه دادههای پزشکی، باید غربالگری شوند تا اطمینان حاصل شود که هیچ اطلاعات قابل شناسایی در آن گنجانده نشده است، در نتیجه به حریم خصوصی کاربران و بیمارانی که مدلها بر اساس دادههای آنها آموزش دیدهاند، احترام گذاشته شود. برای دادههای جمعسپاری، مدلهای هوش مصنوعی معمولاً شامل شرایط و ضوابط حفظ حریم خصوصی میشوند. شرکت کنندگان در مطالعه باید اطمینان حاصل کنند که از این شرایط پیروی می کنند و اطلاعاتی را ارائه نمی دهند که بتوان آن را به داوطلب مورد نظر ردیابی کرد.

سوگیری خطر ارثی مدلهای هوش مصنوعی است که دادهها را بر اساس مواد منبع آموزشی مدل تغییر میدهند. بیشتر مدلهای هوش مصنوعی بر روی مجموعه دادههای گسترده، که معمولاً از اینترنت به دست میآیند، آموزش میبینند.

“علیرغم تلاش های توسعه دهندگان برای کاهش سوگیری ها، شناسایی و درک کامل سوگیری های LLM های قابل دسترس به دلیل عدم شفافیت در مورد داده ها و فرآیند آموزشی چالش برانگیز است. در نهایت، استراتژی هایی با هدف به حداقل رساندن این خطرات شامل اعمال اختیار بیشتر در انتخاب است. دادههای آموزشی، حسابرسی کامل خروجیهای هوش مصنوعی مولد، و برداشتن گامهای اصلاحی برای به حداقل رساندن سوگیریهای شناساییشده.»

نتیجه گیری

مدلهای هوش مصنوعی مولد، که محبوبترین آنها شامل LLMهایی مانند ChatGPT، Microsoft Copilot، Gemini AI و Sora است، برخی از بهترین پیشرفتهای بهرهوری انسان در عصر مدرن را نشان میدهند. متأسفانه، پیشرفتها در این زمینهها به مراتب از بررسیهای اعتبار پیشی گرفته است، که منجر به احتمال خطا، اطلاعات نادرست و سوگیری میشود، که میتواند منجر به عواقب شدید، بهویژه هنگام بررسی مراقبتهای بهداشتی شود. مقاله حاضر برخی از خطرات هوش مصنوعی مولد را در شکل فعلی آن خلاصه می کند و تکنیک های توسعه نیافته برای کاهش این خطرات را برجسته می کند.

مرجع مجله:

- سوریچ، ام جی، منز، بی دی، و هاپکینز، AM (2024). کیفیت و ایمنی اطلاعات سلامت تولید شده توسط هوش مصنوعی در BMJ (ص. q596). BMJDOI – 10.1136/bmj.q596، https://www.bmj.com/content/384/bmj.q596

Source link